Ollamaのインストール

まずは Ollama をインストールします。

Ollamaはローカル環境でLLM(大規模言語モデル)を実行するためのツールで、簡単にローカルAI環境を構築できます。

公式サイトからインストールできます。

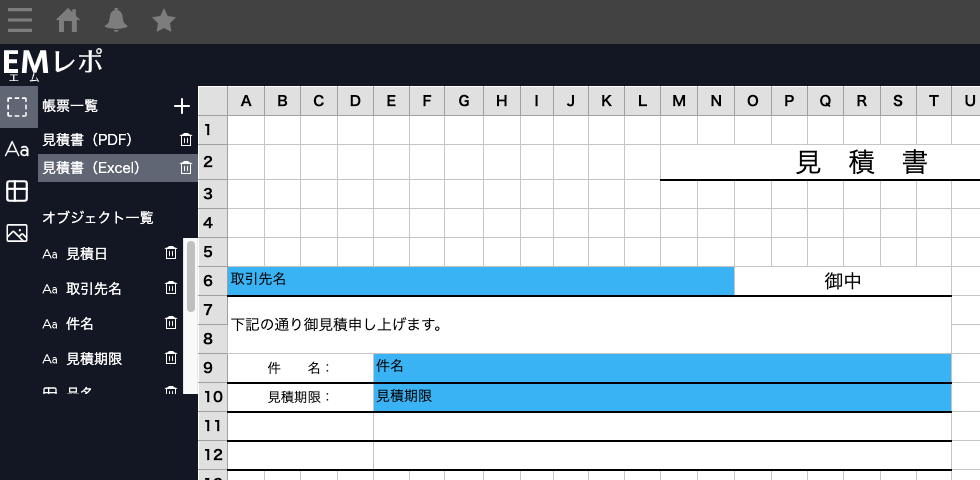

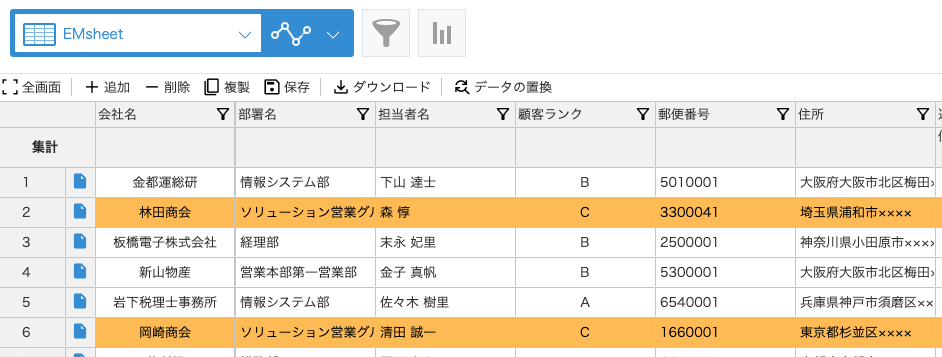

お知らせ①

🌟無料&登録不要でプラグインのお試しが可能!🌟

kintoneユーザーの皆さん!

エムザスのkintoneプラグインはもう試しましたか?🤔

エムザスでは以下のようなプラグインを開発しています!👇

デモ環境で、ほとんどの機能が今すぐお試しいただけます✨

さらに、お客様のドメインで無料で3ヶ月間、すべての機能を試すこともできます!🎉

それでは、本題に入ります!

Macの場合

Macでは brew を使ってインストールできます。

brew install ollamaインストール後、以下のコマンドでOllamaを起動します。

ollama serveWindowsの場合

- 公式サイトにアクセス

- Windows Installerをダウンロード

- インストーラーを実行

インストール後、ターミナルで以下のコマンドを実行します。

ollama run llama3Linuxの場合

Linuxでは次のコマンドでインストールできます。

curl -fsSL https://ollama.com/install.sh | shモデルのダウンロード

Ollamaではコマンド1つでモデルをダウンロードして実行できます。

例として Llama3モデル を実行してみます。

ollama run llama3このコマンドを実行すると

- モデルダウンロード

- 推論エンジン起動

- チャット開始

が自動的に行われます。

Ollama APIサーバーの起動

Ollamaはローカルで APIサーバー として動作させることができます。

ollama serveデフォルトでは次のURLでAPIが起動します。

http://localhost:11434このAPIを利用すると、外部アプリケーションからAIを呼び出せます。

例えば

- Python

- Node.js

- Webアプリ

- 業務システム

などと連携可能です。

Kintoneと連携

このAPIを利用すると Kintone と連携してAI処理を行うこともできます。

例えば次のような構成です。

Kintone

↓

Webhook

↓

Python / Node.js

↓

Ollama API

↓

AI処理

↓

Kintoneに結果を書き戻しこの仕組みを使うことで

- 問い合わせ内容の要約

- 営業メモの整理

- チケット分類

- 社内ナレッジ検索

などの AI業務アシスタント を作ることができます。